Démarrage rapide

Creez votre premier agent

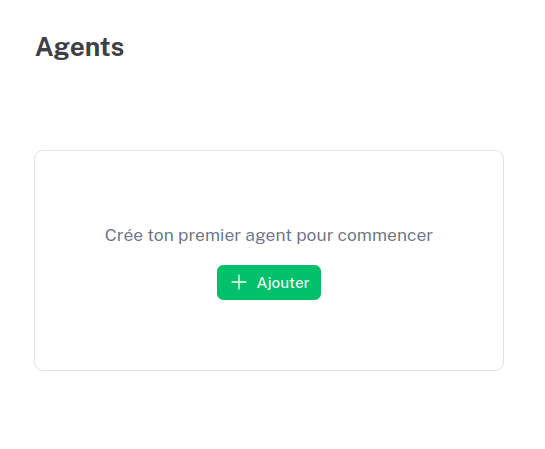

Apres vous etre authentifie via la page de login, vous serez redirigez sur la page d'accueil. Cliquer sur "+ajouter" pour creer votre premier agent

Parametrage du LLM

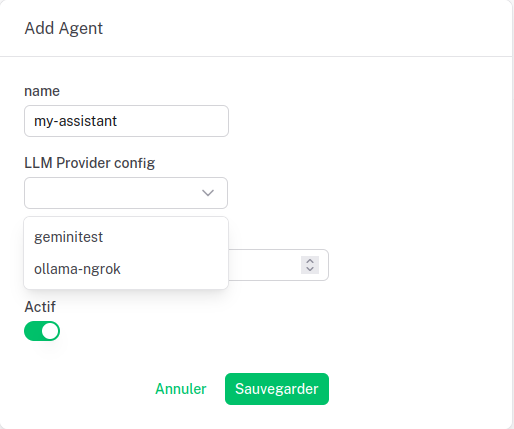

Vous allez voir le formulaire de creation apparaitre, si vous n'avez pas encore sauvegarde un fournisseur LLM, referez vous a cette page de la documentation

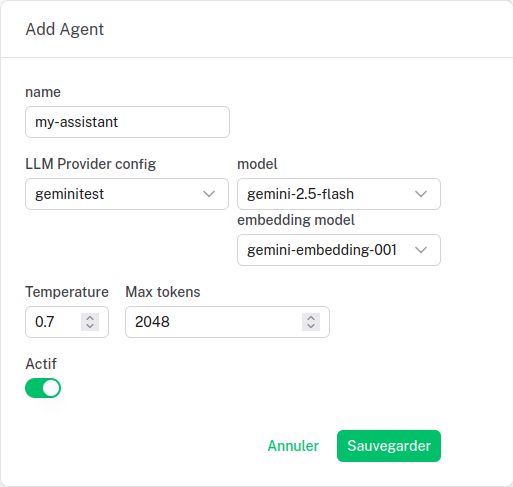

Parametrage des Models

Une fois le fournisseur choisi, vous pouvez selectionner un model de chat et un model d'embedding et enfin configurer les parametres de temperature & max_tokens du chat model.

- temperature : Le paramètre temperature contrôle le degré de hasard dans les réponses du modèle : plus il est élevé, plus la réponse est créative et variée ; plus il est bas, plus elle est déterministe et prévisible.

Note

Pour un assistant de support technique, une temperature entre 0.1 et 0.3 est recommande

Pour un assistant shopping, une temperature entre 0.4 et 0.7 est recommande

- max_tokens : Le paramètre max_tokens définit le nombre maximum de tokens (morceaux de texte) que le modèle est autorisé à générer dans sa réponse.

Note

Le parametre max_token a un impact direct sur le cout de vos requetes API a Gemini et openAI

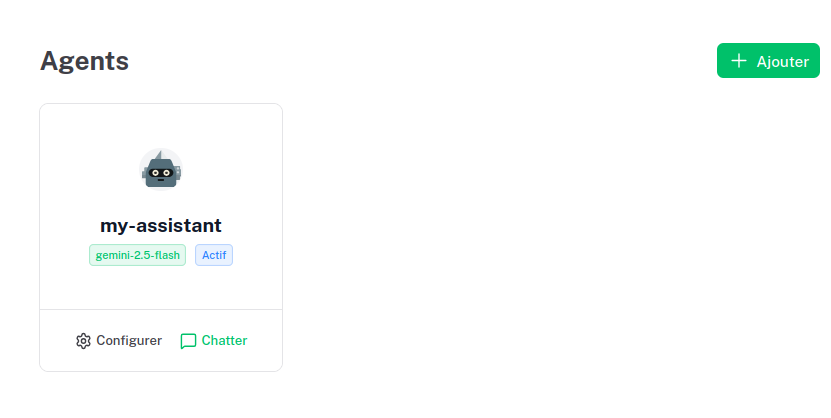

Essayez le Chat

Une fois sauvegarde, vous verrez votre agent apparaitre.

Cliquez sur le lien "chattez" pour ouvrir une fenetre de chat avec l'assistant.

Voila, vous avez creer votre premier agent, vous pouvez maintenant vous rendre dans la section suivante pour apprendre a gerer les documents de la base de connaissances de vos agents.